### 郭毅可:打造可信的人工智能生态 —— 初学者指南

在人工智能(AI)迅速发展的今天,构建一个既高效又可信的AI生态系统成为了行业内外共同关注的焦点。郭毅可教授,作为AI领域的权威专家,多次强调建立可信AI的重要性,这不仅是技术进步的体现,更是对社会伦理与安全的负责。本指南将基于郭毅可教授的理念,为初学者提供一套打造可信AI生态的详细步骤,帮助大家理解并实施这一复杂而重要的任务。

#### 步骤一:明确可信AI的定义与目标

**解释**:首先,我们需要清晰界定什么是“可信AI”。可信AI不仅要求技术上的准确与高效,还涵盖了透明度、公平性、隐私保护、安全性以及可解释性等多个维度。

**示例**:设想一个医疗诊断AI系统,其可信度不仅体现在诊断结果的准确性上,还应包括患者数据的隐私保护措施、系统决策的可解释性(即医生能够理解为何AI给出了特定诊断),以及对不同人群(如性别、年龄、种族)的公平对待。

#### 步骤二:数据收集与预处理:确保质量与多样性

**解释**:高质量、多样化的数据是训练可信AI模型的基础。数据应经过严格清洗,去除偏见,并确保隐私合规。

**步骤**:

1. **数据收集**:多渠道获取数据,包括公开数据集、合作伙伴提供的数据等。

2. **数据清洗**:识别并处理缺失值、异常值,确保数据完整性。

3. **去偏见处理**:使用统计方法检测并减轻数据中的偏见,如性别、种族偏见。

4. **隐私保护**:采用匿名化、差分隐私等技术保护个人数据隐私。

**示例**:在收集面部识别数据时,确保数据集包含不同年龄、性别、肤色的样本,同时采用差分隐私技术处理图像数据,减少个人隐私泄露风险。

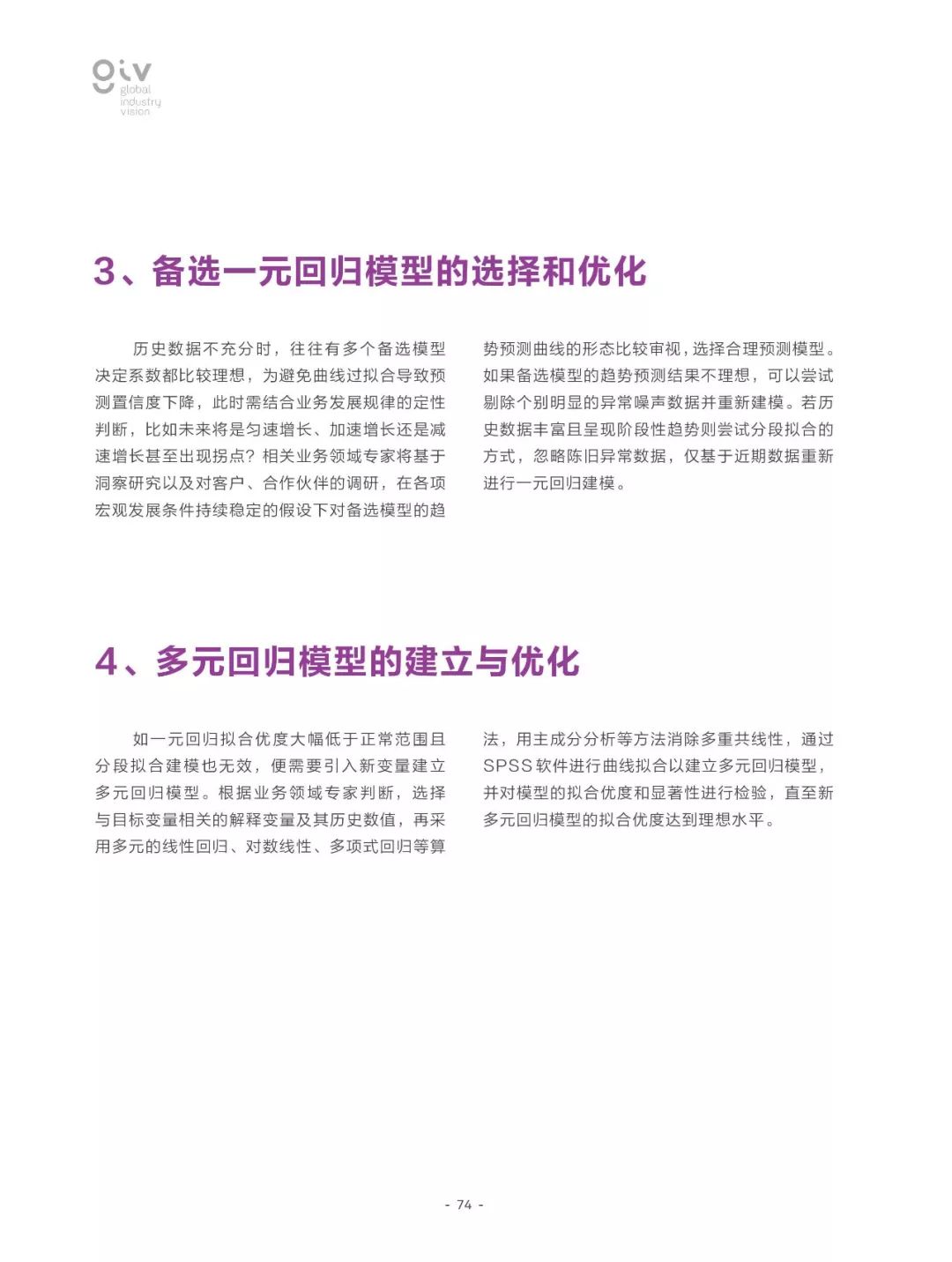

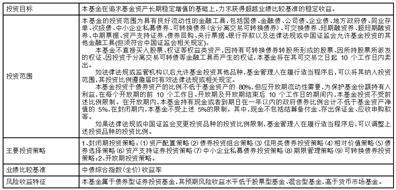

#### 步骤三:选择并优化AI模型

**解释**:根据应用场景选择合适的AI模型,并通过调优提升模型性能,同时注重模型的可解释性。

**步骤**:

1. **模型选择**:基于任务需求(如分类、回归、生成等)选择合适的算法框架。

2. **模型训练**:利用预处理后的数据进行模型训练,监控训练过程中的损失函数和准确率。

3. **模型调优**:通过超参数调整、集成学习等技术优化模型性能。

4. **可解释性增强**:采用LIME、SHAP等工具增加模型决策的可解释性。

**示例**:在信用评分模型中,选择逻辑回归作为基础模型,因其输出易于解释,同时通过梯度提升决策树(GBDT)进行集成学习,提升预测精度。

#### 步骤四:实施伦理审查与监管

**解释**:建立伦理审查机制,确保AI系统的开发、部署全过程符合伦理标准,接受第三方监管。

**步骤**:

1. **伦理指南制定**:参考国内外AI伦理准则,制定企业内部的AI伦理规范。

2. **伦理审查流程**:设立伦理审查委员会,对AI项目进行定期审查,包括数据使用、算法设计、社会影响评估。

3. **透明度提升**:向公众公开AI系统的运作原理、决策逻辑,接受社会监督。

**示例**:企业开发一款智能招聘系统时,需通过伦理审查确保系统不会因算法偏见排斥特定群体,同时公开系统的评估标准和决策逻辑,增强公众信任。

#### 步骤五:持续监测与迭代

**解释**:可信AI的建设是一个持续的过程,需要不断监测模型性能、社会影响,并根据反馈进行迭代优化。

**步骤**:

1. **性能监控**:建立模型性能监控系统,实时跟踪准确率、响应时间等指标。

2. **社会影响评估**:定期收集用户反馈,评估AI系统对社会、环境的影响。

3. **迭代优化**:根据监控结果和评估反馈,调整模型参数、优化算法,甚至重新设计系统架构。

**示例**:在智能客服系统中,通过用户满意度调查发现系统对某些复杂问题的处理能力不足,随后引入更先进的自然语言处理技术和知识图谱,提升用户体验。

### 结语

构建可信的人工智能生态是一项系统工程,需要从数据、模型、伦理、监管等多个维度综合考虑。郭毅可教授的理念为我们提供了宝贵的指导,即技术发展与伦理责任并重。作为初学者,通过遵循上述步骤,可以逐步掌握打造可信AI的关键技能,为人工智能的健康发展贡献力量。

7777788888精准免费4肖与7777788888精准管家婆,词语释义、解释和落实和警惕虚假宣传-全面释义、解释和落实

转载请注明来自上海胜佰财务咨询有限公司,本文标题:《郭毅可致力于构建可靠的人工智能生态系统》

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号